大模型驱动AI手机进化:隐私保护成关键

大模型催化AI手机进化:个人隐私如何不再“裸奔”?

引言

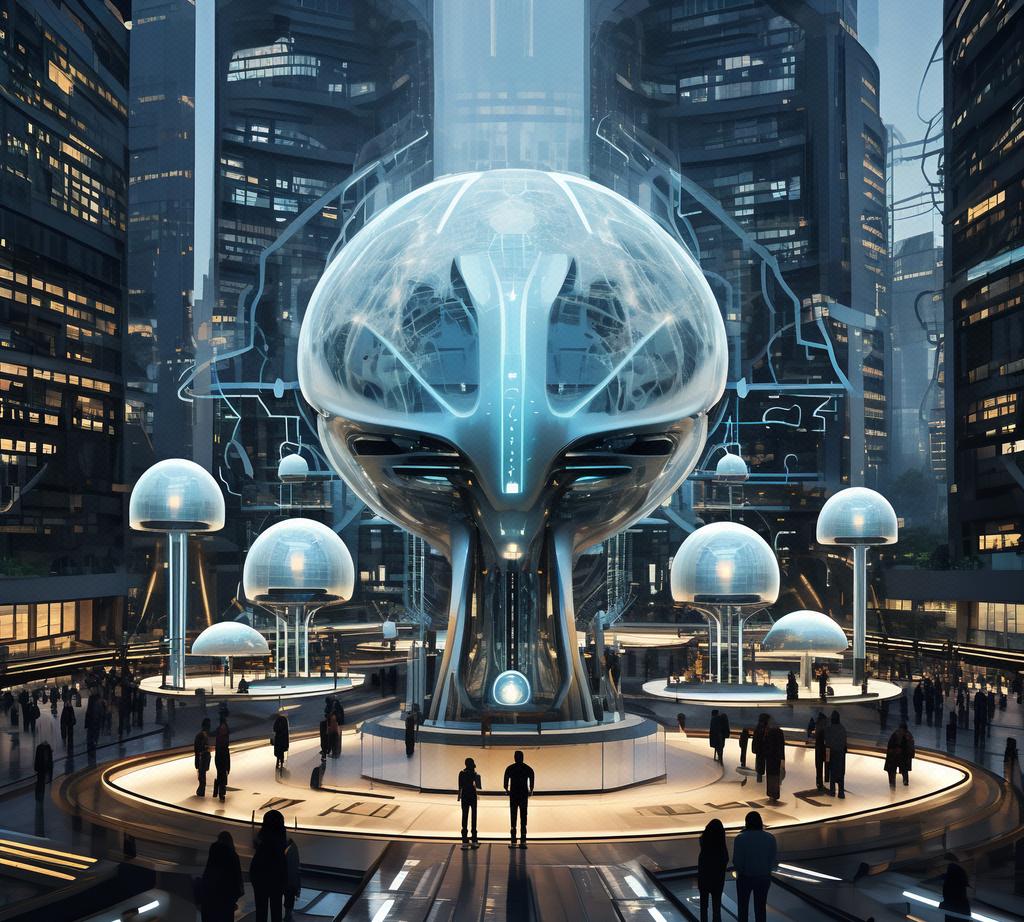

随着人工智能(AI)技术的飞速发展,大型模型(大模型)正逐步成为推动手机行业进化的重要力量。从智能助手到个性化推荐,AI手机正以前所未有的方式改变着我们的生活。然而,在享受AI带来的便利的同时,个人隐私保护问题也日益凸显。如何在AI手机进化的浪潮中,确保个人隐私不“裸奔”,成为了一个亟待解决的问题。

大模型与AI手机的融合

技术背景

大模型,以其强大的数据处理能力和深度学习能力,为AI手机提供了前所未有的智能支持。这些模型能够处理海量数据,识别复杂模式,并据此提供个性化的服务和建议。在AI手机的背景下,大模型的应用使得手机能够更准确地理解用户需求,提供更加贴心的服务。例如,谷歌的TensorFlow和Facebook的PyTorch等开源框架,为开发者提供了构建和训练大模型的基础工具,推动了AI技术在手机中的广泛应用。

实际应用

-

智能助手:AI手机中的智能助手,如Siri、小爱同学等,已经能够识别用户的语音指令,执行各种任务。大模型的引入,使得这些助手能够更准确地理解用户的意图,提供更加精准的服务。例如,Siri不仅能识别用户的语音指令,还能根据上下文理解用户的情绪和需求,提供更加人性化的服务。

-

个性化推荐:基于用户的浏览历史、购买记录等信息,AI手机能够为用户提供个性化的内容推荐。大模型的应用,使得这些推荐更加精准,更符合用户的喜好。例如,淘宝和京东等电商平台利用大模型技术,为用户提供个性化的商品推荐和广告展示。

-

安全保护:虽然大模型在提升手机智能方面发挥了重要作用,但其在个人隐私保护方面的应用同样值得关注。通过深度学习算法,大模型能够识别并拦截潜在的恶意软件,保护用户的隐私安全。例如,腾讯的手机管家和360安全卫士等安全软件,利用大模型技术检测并清除恶意软件。

个人隐私保护面临的挑战

数据泄露风险

随着AI手机功能的日益丰富,用户在手机上的行为数据也变得越来越丰富。这些数据包括用户的浏览记录、位置信息、通话记录等,一旦泄露,将对用户的个人隐私造成严重威胁。例如,2018年Facebook数据泄露事件导致8700万用户的数据被泄露,引发了全球对个人隐私保护的关注。

恶意软件攻击

随着AI技术的普及,恶意软件也变得越来越复杂和隐蔽。这些软件能够利用AI手机的漏洞,窃取用户的个人信息,甚至控制用户的手机。例如,2019年“幽灵推送”恶意软件事件导致数百万安卓用户的数据被窃取。

监管缺失

在AI手机领域,个人隐私保护的法律法规尚不完善。这导致了一些企业在收集和使用用户数据时存在不规范的行为,进一步加剧了个人隐私泄露的风险。例如,2020年美国加州通过了《加州消费者隐私法案》,要求企业向用户透明化其数据收集和使用行为。然而,该法案的适用范围有限,并未涵盖所有AI手机应用。

个人隐私保护的策略与实践

加强技术防护

-

数据加密:通过数据加密技术,确保用户数据在传输和存储过程中的安全性。这可以有效防止数据在传输过程中被截获或在存储过程中被窃取。例如,苹果公司的iPhone采用端到端加密技术保护用户数据的安全。

-

安全认证:采用生物识别技术(如指纹、面部识别)或密码认证等方式,确保只有授权用户才能访问手机中的敏感数据。例如,华为手机的指纹解锁和面部识别功能有效提高了用户数据的安全性。

-

恶意软件检测:利用大模型的深度学习算法,实时监测手机中的恶意软件,并及时进行拦截和清除。例如,腾讯的手机管家和360安全卫士等安全软件利用大模型技术检测并清除恶意软件。

完善法律法规

-

制定隐私保护政策:政府应制定明确的隐私保护政策,规范企业在收集和使用用户数据时的行为。例如,《欧盟通用数据保护条例》(GDPR)要求企业在收集和使用用户数据时必须遵守严格的隐私保护规定。

-

加强监管力度:建立健全的监管机制,对违反隐私保护政策的企业进行处罚,确保个人隐私得到切实保护。例如,美国联邦贸易委员会(FTC)对违反隐私保护政策的企业进行罚款和处罚。

提升用户意识

-

加强宣传教育:通过媒体、社交平台等渠道加强个人隐私保护的宣传教育提高用户的隐私保护意识。例如,《纽约时报》等媒体经常报道个人隐私泄露事件并提醒用户注意隐私保护。

-

鼓励用户参与:鼓励用户积极参与个人隐私保护活动如定期更换密码、不随意泄露个人信息等。例如,“密码管理器”应用帮助用户生成和存储复杂密码并定期提醒更换密码。