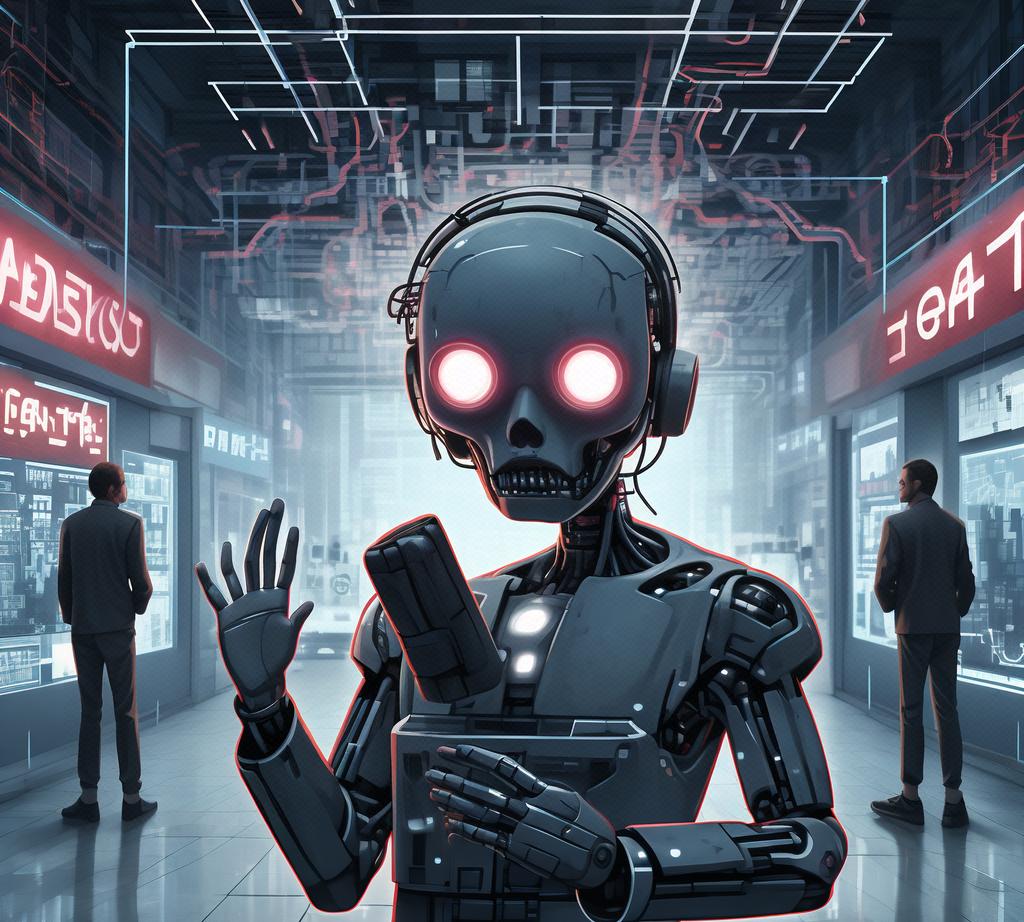

警惕AI认知偏差:理性发展智能技术

避免“人工智能+”的两个认识偏差:深度剖析与应对策略

随着科技的飞速发展,人工智能(AI)已经渗透到我们生活的方方面面,从智能家居到自动驾驶,从医疗诊断到金融风控,AI的应用场景日益丰富。然而,在“人工智能+”的浪潮中,我们也必须警惕一些认识上的偏差,这些偏差可能会阻碍AI技术的健康发展,甚至对社会经济产生负面影响。本文将深入探讨两个主要的认识偏差,并通过具体案例提出应对策略。

一、认识偏差一:过度神化AI,忽视其局限性

现象描述

在当前的舆论环境中,AI往往被赋予了超乎寻常的能力,仿佛它能够解决一切问题。这种过度神化AI的现象,不仅体现在普通民众的认知中,也在一些专业人士和决策者中有所体现。他们往往认为,只要有了AI,就能实现生产效率的飞跃、社会问题的迎刃而解。

案例分析

以医疗领域为例,虽然AI在辅助诊断、药物研发等方面取得了显著进展,但并不能完全替代医生的专业判断。例如,在2018年,谷歌的AI医疗影像系统被曝出在识别乳腺癌方面的准确率低于专业医生。这一事件揭示了AI在医疗领域的局限性,尤其是在需要高度专业知识和经验积累的领域。

应对策略

- 理性看待AI:我们应该认识到,AI虽然强大,但并非无所不能。它有自己的适用范围和局限性,不能盲目替代人类的专业知识和经验。

- 加强跨学科合作:在AI的应用过程中,需要加强与相关领域的专家合作,共同探索AI的合理使用方式,避免过度依赖和误用。

二、认识偏差二:忽视AI的伦理和社会影响

现象描述

在追求AI技术发展的同时,一些人往往忽视了其可能带来的伦理和社会问题。例如,AI可能加剧就业不平等、侵犯个人隐私、引发伦理争议等。这些问题如果不加以重视和解决,将对社会的和谐稳定构成威胁。

案例分析

以自动驾驶为例,虽然这项技术有望提高交通效率和安全性,但也可能引发一系列伦理问题。例如,在紧急情况下,自动驾驶汽车应该如何决策:是保护乘客还是行人?这类问题在现实中已经引发了广泛的讨论和争议。

应对策略

- 建立伦理规范:在AI的研发和应用过程中,需要建立相应的伦理规范,明确AI的使用原则和界限,确保技术的发展符合社会伦理和道德标准。

- 加强监管和评估:政府和相关机构应加强对AI技术的监管和评估,及时发现和解决潜在的社会问题,确保AI技术的健康发展。

三、结论与未来展望

“人工智能+”的时代已经到来,但我们在享受AI带来的便利和机遇的同时,也必须警惕其可能带来的认识偏差。通过理性看待AI、加强跨学科合作、建立伦理规范和加强监管评估等措施,我们可以更好地应对这些挑战,推动AI技术的健康发展。未来,随着技术的不断进步和社会各界的共同努力,我们有理由相信,AI将在更多领域发挥积极作用,为社会的繁荣和进步贡献力量。然而,这需要我们保持清醒的头脑和审慎的态度,确保技术的发展始终符合人类的利益和价值观。