定制ASIC芯片:加速AI的幕后推手

加速AI:定制ASIC芯片对高级计算的影响

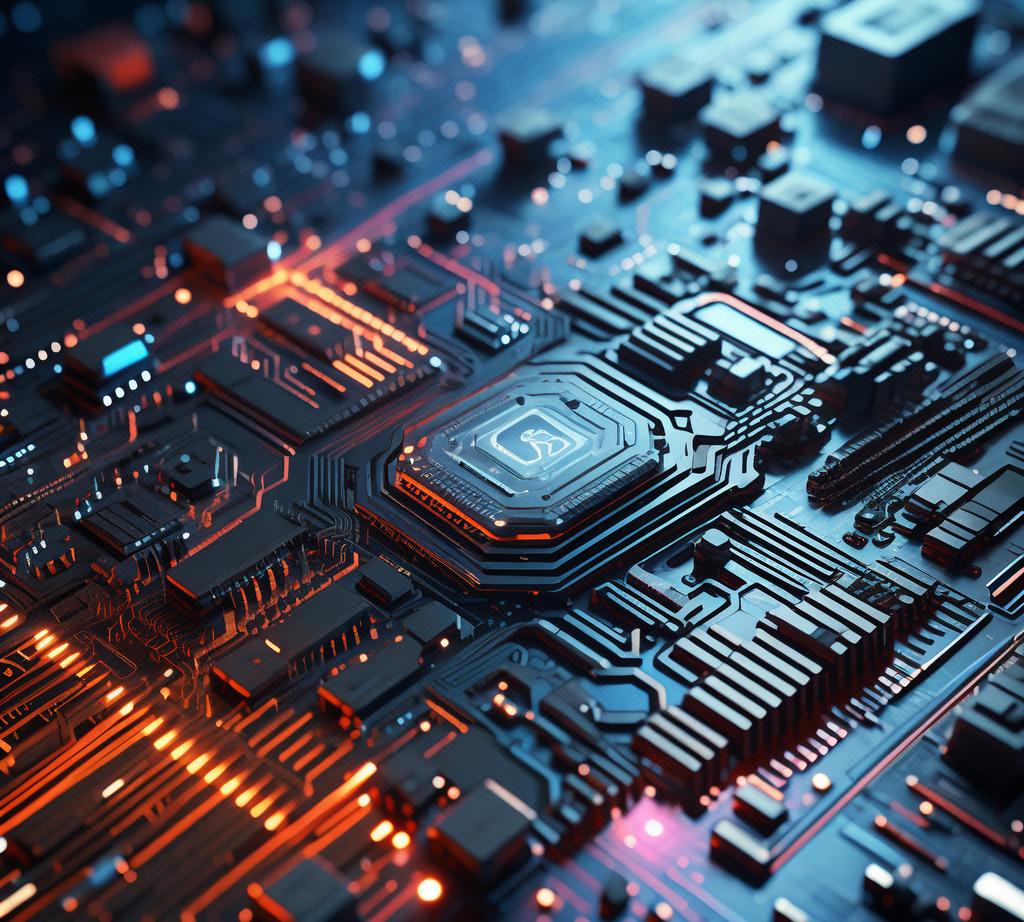

随着人工智能(AI)技术的飞速发展,高级计算领域正经历着前所未有的变革。在这场变革中,定制ASIC(Application-Specific Integrated Circuit,专用集成电路)芯片扮演着至关重要的角色。本文将深入探讨定制ASIC芯片对高级计算的影响,通过引用具体案例和事实,揭示其背后的技术原理和市场趋势。

一、定制ASIC芯片概述

ASIC芯片是针对特定应用而设计的集成电路,与通用处理器(如CPU和GPU)相比,ASIC在性能、功耗和成本方面具有显著优势。它们通过优化硬件架构和算法,实现了对特定任务的加速处理,从而提高了整体计算效率。

在AI领域,定制ASIC芯片的应用尤为广泛。由于AI算法具有高度的复杂性和多样性,传统的通用处理器难以满足其高性能和低功耗的需求。因此,越来越多的AI企业开始采用定制ASIC芯片来加速AI算法的执行,提高计算速度和准确性。

二、定制ASIC芯片对高级计算的影响

2.1 性能提升

定制ASIC芯片通过针对特定AI算法进行优化,实现了显著的性能提升。例如,Google的Tensor Processing Unit(TPU)就是一种专为深度学习设计的ASIC芯片。与GPU相比,TPU在训练深度学习模型时具有更高的能效比和更低的延迟。这使得Google能够在更短的时间内完成大规模的AI训练任务,从而加速了AI技术的研发和应用。

2.2 功耗降低

定制ASIC芯片的另一个重要优势是功耗降低。由于它们针对特定任务进行了优化,因此可以在实现高性能的同时保持较低的功耗。这对于需要长时间运行和高能效比的AI应用来说至关重要。例如,在数据中心和云计算领域,采用定制ASIC芯片可以显著降低能耗成本,提高整体运营效率。

2.3 成本优化

虽然定制ASIC芯片的研发和生产成本较高,但在大规模应用中,其成本效益却非常显著。由于ASIC芯片可以针对特定任务进行高度优化,因此可以在保证性能的同时降低单位成本。这对于需要大规模部署AI应用的企业来说是一个重要的考虑因素。

三、具体案例分析

3.1 Google TPU

如前所述,Google的TPU是一种专为深度学习设计的ASIC芯片。它采用了独特的架构和算法,实现了对深度学习模型的高效加速。通过TPU,Google能够在更短的时间内完成大规模的AI训练任务,从而推动了AI技术的快速发展。此外,TPU还具有较低的功耗和成本效益,使得Google能够在数据中心和云计算领域保持领先地位。

3.2 Intel Nervana NNP-I

Intel的Nervana NNP-I是另一种专为深度学习设计的ASIC芯片。它采用了独特的神经网络处理单元(NPU)架构,实现了对深度学习算法的高效加速。与GPU相比,NNP-I在性能和功耗方面都具有显著优势。这使得Intel能够在AI领域保持竞争力,并推动其数据中心和云计算业务的发展。

四、市场趋势与展望

随着AI技术的不断发展和应用领域的不断扩大,定制ASIC芯片的市场需求将持续增长。未来,我们可以预见以下几个市场趋势:

- 技术创新:随着半导体技术的不断进步,定制ASIC芯片的性能和功耗将进一步提升。同时,新的架构和算法也将不断涌现,为AI应用提供更多样化的加速方案。例如,基于量子计算的ASIC芯片正在研发中,有望在未来实现更高效的计算性能。

- 生态构建:为了推动定制ASIC芯片的应用和发展,越来越多的企业开始构建AI生态体系。这包括与芯片制造商、算法开发者、系统集成商等合作伙伴建立紧密的合作关系,共同推动AI技术的创新和应用。例如,一些企业正在建立开放的AI平台,以支持多种硬件加速器和算法框架的集成和应用。

- 行业应用:随着AI技术在各个行业的广泛应用,定制ASIC芯片也将逐渐渗透到各个领域。例如,在自动驾驶、智能制造、智慧城市等领域,定制ASIC芯片将发挥重要作用,推动这些领域的智能化和数字化转型。此外,随着物联网(IoT)的快速发展,定制ASIC芯片也将成为连接万物的重要基石之一。

结语

定制ASIC芯片作为高级计算领域的重要技术之一,正在深刻改变着AI技术的发展和应用格局。通过优化硬件架构和算法,定制ASIC芯片实现了对特定任务的加速处理,提高了计算效率和准确性。未来随着技术的不断进步和应用领域的不断扩大定制ASIC芯片将在AI领域发挥更加重要的作用推动人工智能技术的创新和发展。