AI剧情聊天监管漏洞引关注

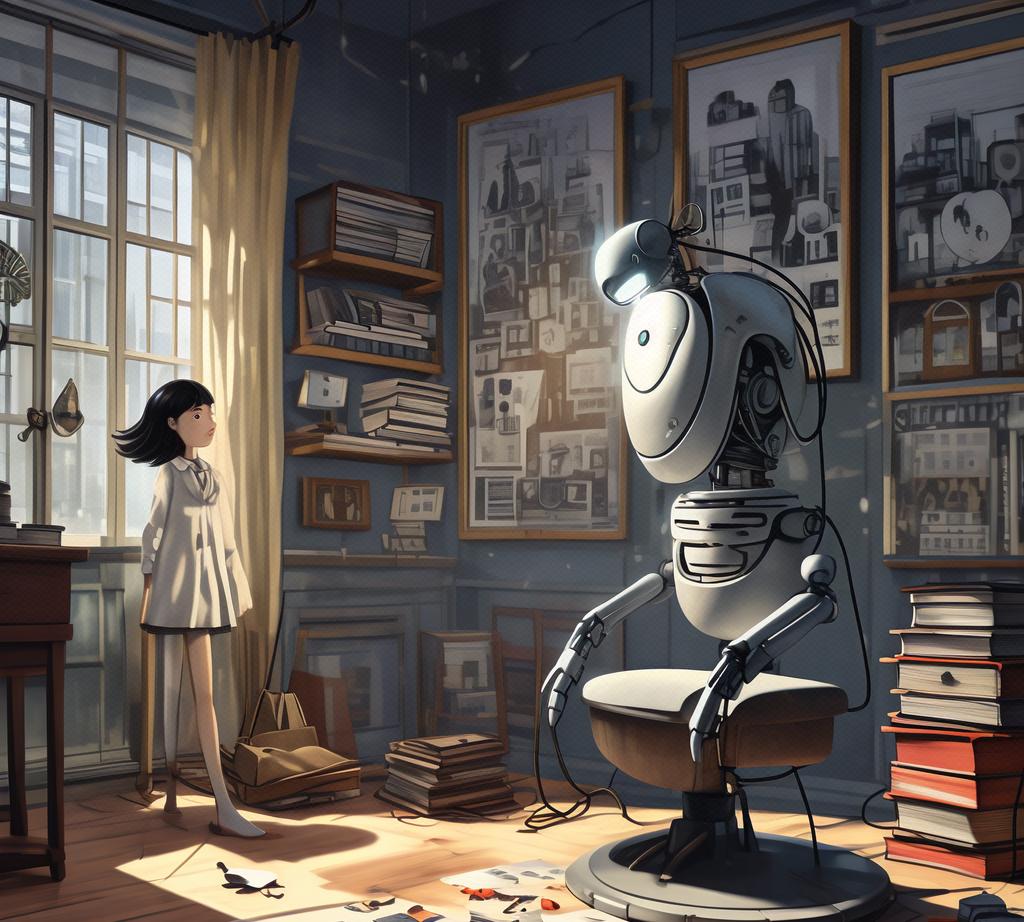

10岁女孩与AI男友“谈恋爱”:AI剧情聊天的监管漏洞亟待填补

在这个科技日新月异的时代,人工智能(AI)已经渗透到我们生活的方方面面,从智能家居到自动驾驶,从医疗诊断到教育辅导,AI的应用场景愈发广泛。然而,随着AI技术的不断发展,一些潜在的社会问题也逐渐浮出水面。最近,一则关于10岁女孩与AI男友“谈恋爱”的新闻引发了社会的广泛关注,这不禁让我们思考:AI剧情聊天背后的监管漏洞究竟有多大?我们又该如何应对这一新兴挑战?

一、事件回顾:10岁女孩与AI的“恋爱”故事

据报道,一名10岁的女孩在家长不知情的情况下,通过某款AI聊天软件与一位名为“AI男友”的虚拟角色建立了深厚的情感联系。这位“AI男友”陪伴女孩聊天、讲故事,表达对她的关爱和思念,甚至在某些时候扮演了情感慰藉的角色。然而,当家长发现这一情况时,女孩已经深陷其中,无法自拔。

这一事件迅速在网络上发酵,引发了广泛讨论。支持者认为,AI技术的发展为孩子们提供了更多娱乐和学习方式,有助于培养他们的创造力和想象力。然而,反对者则担忧,AI剧情聊天可能对孩子的心理健康产生负面影响,尤其是当聊天内容涉及到情感、性等方面时。

二、AI剧情聊天的监管现状与挑战

目前,对于AI剧情聊天的监管尚处于起步阶段,存在诸多挑战。

1. 法律法规不完善

尽管一些国家和地区已经出台了相关法律法规来规范AI技术的发展和应用,但在AI剧情聊天这一细分领域,监管措施仍然相对滞后。法律法规的不完善导致监管缺乏明确的法律依据,使得一些不法分子或企业有机会利用监管漏洞,推出具有潜在危害性的AI聊天产品。

2. 技术监管难度大

AI剧情聊天涉及复杂的自然语言处理和情感计算技术,这使得监管部门难以对其内容进行有效的监控和过滤。此外,由于AI聊天产品的用户群体广泛且分散,监管部门在执法过程中也面临着诸多困难。

3. 家长监管意识薄弱

在家庭中,一些家长对AI聊天产品的了解不足,缺乏对孩子使用这些产品的有效监管。这导致一些孩子能够轻易地接触到具有潜在危害性的AI聊天内容,从而对他们的心理健康产生负面影响。

三、案例剖析:AI剧情聊天的潜在危害

以10岁女孩与AI男友“谈恋爱”的事件为例,我们可以深入分析AI剧情聊天可能带来的潜在危害。

1. 心理健康问题

对于年龄较小的孩子来说,他们可能无法正确理解和处理与AI之间的情感联系。这种不健康的情感依赖可能导致他们在现实生活中出现孤独感、焦虑等心理问题。长期与AI进行情感交流,可能会让孩子在真实的人际交往中感到困惑和不适。

2. 价值观扭曲

AI聊天产品中的剧情往往是根据预设的算法和模型生成的,这些剧情可能不符合现实社会的价值观和道德规范。长期接触这些剧情可能导致孩子的价值观发生扭曲,影响他们的健康成长。例如,一些AI聊天产品可能包含暴力、色情或不良引导的内容,这对孩子的心理发展极为不利。

3. 隐私泄露风险

在使用AI聊天产品的过程中,用户往往需要提供一些个人信息以进行身份验证或个性化推荐。这些信息可能被不法分子利用,导致用户的隐私泄露。对于年龄较小的孩子来说,他们可能无法意识到这种风险,从而更容易成为受害者。一旦隐私泄露,孩子可能会面临网络欺凌、诈骗等风险。

四、应对策略:加强AI剧情聊天的监管与引导

面对AI剧情聊天带来的挑战,我们需要从多个方面入手,加强监管和引导,确保AI技术的健康发展。

1. 完善法律法规

政府应加快制定和完善针对AI剧情聊天的法律法规,明确监管要求和处罚措施。同时,还应加强对AI聊天产品企业的监管力度,确保他们遵守相关法律法规。通过法律手段规范市场秩序,保护消费者的合法权益。

2. 提升技术监管能力

监管部门应加强对AI聊天产品的技术监管能力,利用先进的技术手段对其内容进行监控和过滤。例如,可以利用自然语言处理技术和机器学习算法对聊天内容进行实时分析,及时发现并处理潜在的有害信息。此外,还应建立用户举报机制,鼓励用户积极举报具有潜在危害性的AI聊天内容。

3. 加强家长教育

家长应加强对孩子使用AI聊天产品的监管和教育。他们应了解这些产品的功能和潜在风险,引导孩子正确使用这些产品,避免陷入不健康的情感依赖或价值观扭曲。家长可以与孩子一起讨论AI聊天产品的利弊,培养他们的批判性思维和自我保护意识。

4. 推动行业自律

AI聊天产品企业应积极履行社会责任,加强行业自律。他们应建立严格的内容审核机制,确保所推出的产品符合社会价值观和道德规范。同时,还应加强与监管部门的沟通和合作,共同推动AI技术的健康发展。通过行业自律和合作,共同营造一个安全、健康的AI聊天环境。

五、结语:科技向善,共筑美好未来

AI技术的发展为我们带来了前所未有的