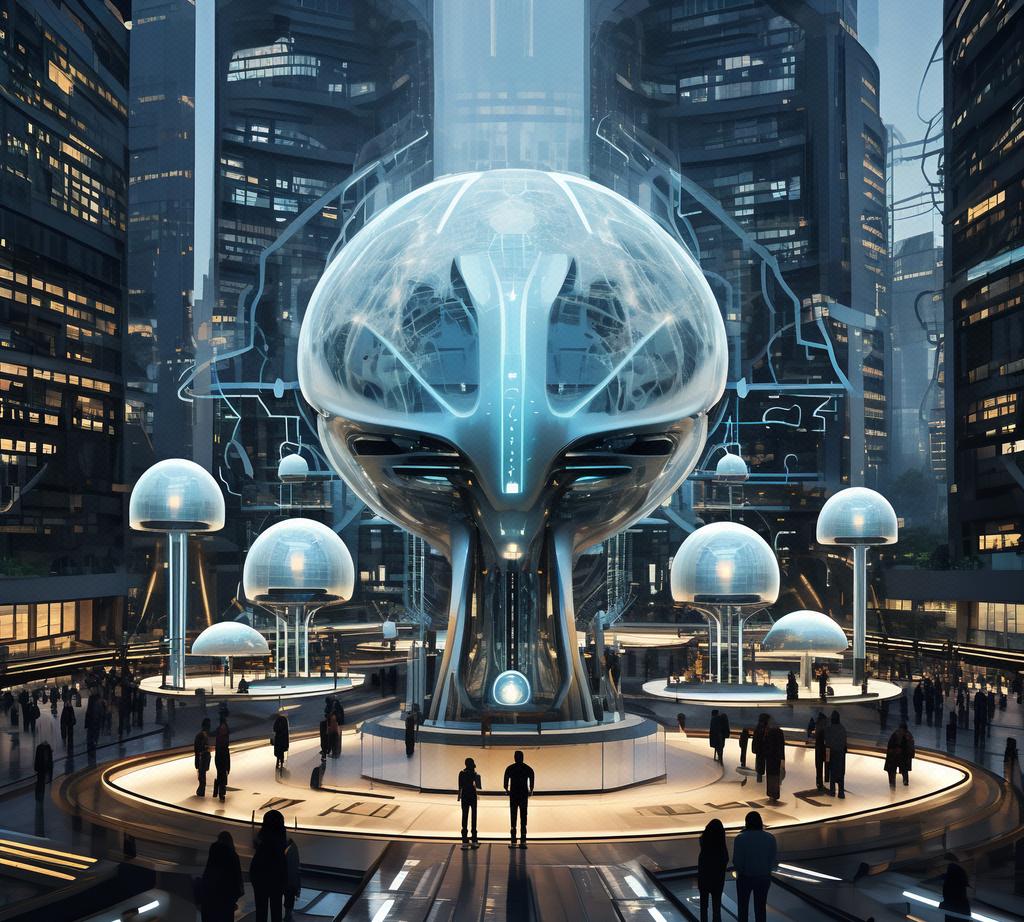

大模型安全检测与防护新洞察

安全建设新场景:大模型安全检测与防护解决方案的深度洞察

在当今数字化转型的浪潮中,人工智能(AI)技术,特别是大型语言模型(LLM),正以前所未有的速度重塑各行各业。从智能客服到自动驾驶,从医疗诊断到金融风控,LLM的应用场景日益丰富。然而,随着这些技术的广泛应用,其安全性问题也日益凸显,成为制约AI进一步发展的关键因素。近日,一份关于“大模型安全检测与防护解决方案”的品牌推荐与洞察报告正式发布,为我们揭示了这一领域的最新进展和最佳实践。本文将基于该报告,深入探讨大模型安全的新场景、挑战以及相应的解决方案。

一、大模型安全的新场景

1.1 数据泄露与隐私保护

随着LLM处理的数据量激增,数据泄露和隐私保护成为首要挑战。LLM在训练过程中需要接触大量敏感信息,如用户对话记录、交易历史等。一旦这些数据被不当使用或泄露,将造成严重后果,不仅损害用户利益,还可能引发法律纠纷。因此,如何确保数据在采集、存储、处理、传输等全生命周期内的安全性,成为大模型安全的重要课题。

1.2 模型偏见与公平性

LLM的决策过程往往受到训练数据的影响,导致模型偏见问题。这种偏见不仅影响模型的准确性,还可能加剧社会不公,如性别、种族歧视等。例如,某些模型在识别面部特征时可能对不同种族存在偏见,导致误判率上升。因此,如何检测和校正模型偏见,确保AI技术的公平性和公正性,成为亟待解决的问题。

1.3 对抗攻击与鲁棒性

对抗攻击是指通过精心设计的输入,使LLM产生错误输出或行为。这种攻击方式具有隐蔽性和针对性,严重威胁到AI系统的可靠性和安全性。例如,通过添加微小扰动到输入图像中,可以使图像分类模型误判。因此,如何提高模型对恶意输入的识别能力,增强模型的鲁棒性,成为大模型安全的重要研究方向。

二、大模型安全检测与防护解决方案

2.1 数据加密与匿名化处理

为解决数据泄露问题,采用数据加密和匿名化处理技术是关键。通过加密存储和传输过程中的敏感数据,确保数据在不被授权的情况下无法被访问或篡改。同时,使用差分隐私等匿名化方法,对敏感数据进行处理,使其在满足数据分析需求的同时,保护用户隐私。这些技术的应用可以有效降低数据泄露的风险。

2.2 偏见检测与校正

针对模型偏见问题,开发偏见检测工具,定期审查模型输出,识别并校正潜在的偏见。通过引入多样性数据集和公平性约束,优化模型训练过程,减少偏见产生。此外,建立偏见反馈机制,鼓励用户报告模型偏见问题,以便及时进行调整和改进。这些措施有助于确保AI技术的公平性和公正性。

2.3 对抗攻击防御

对于对抗攻击,研究并应用鲁棒性优化技术,如对抗训练、防御蒸馏等。通过将这些技术融入模型训练过程,提高模型对恶意输入的识别能力。此外,建立实时监测和预警系统,及时发现并应对潜在的安全威胁。这些防御策略的应用可以增强模型的鲁棒性,提高AI系统的可靠性。

三、案例分享:某科技公司的安全实践

3.1 数据安全管理体系

某科技公司构建了完善的数据安全管理体系,涵盖数据加密、访问控制、审计追踪等关键环节。通过采用先进的加密技术,确保数据在存储和传输过程中的安全性。同时,实施严格的访问控制策略,限制对敏感数据的访问权限。此外,定期进行安全审计和漏洞扫描,及时发现并修复潜在的安全隐患。这些措施共同构成了该公司数据安全管理的坚实防线。

3.2 偏见校正与公平性提升

该公司还开发了偏见检测与校正系统,通过算法优化和人工审核相结合的方式,确保模型输出的公正性和准确性。该系统能够自动识别并校正模型中的偏见问题,提高AI技术的公平性。同时,该公司积极参与社会公益活动,推动AI技术的公平应用,为构建和谐社会贡献力量。

3.3 对抗攻击防御实践

面对对抗攻击,该公司采用了多种防御策略,包括对抗训练、模型集成等。通过不断迭代和优化模型,提高了对恶意输入的识别能力和鲁棒性。此外,该公司还建立了应急响应机制,确保在发生安全事件时能够迅速响应并恢复服务。这些防御实践的应用有效提升了该公司AI系统的安全性和可靠性。

四、未来展望

随着AI技术的不断发展,大模型安全检测与防护将成为一个持续演进的过程。未来,我们需要更加关注以下几个方向:

- 技术创新:不断探索新的安全技术和方法,如基于深度学习的异常检测、自适应安全策略等,以提高模型的安全性和可靠性。

- 法规遵从:加强法律法规建设,明确AI技术的安全标准和责任主体。通过制定和完善相关法律法规,为AI技术的